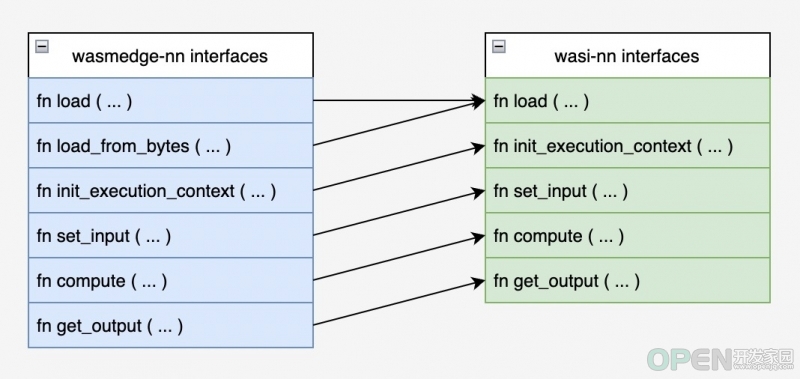

在上一篇文章中,我们展示了如何使用 OpenVINO 构建一个道路分割的机器学习推理任务。在这个过程中,我们观察到两个有趣且值得进一步完善的工作: 在示例中使用到了 wasi-nn crate,其为 WASI-NN 提案提供了 Rust 接口实现,从而大大降低了使用 Rust 语言构建基于 WebAssembly 技术的机器学习任务的流程复杂度。不过,wasi-nn crate 提供的接口是 unsafe 的,更适合作为底层API 用于构建更高层的库。因此,我们可以基于 wasi-nn crate 创建一个提供 safe 接口的库。 在对输入图片进行预处理的时候,我们使用到了 opencv crate 。但是,因为 opencv crate 无法编译为 wasm 模块,所以就不得不将图片预处理模块独立出来,单独作为一个项目来实现。 对于上述两个观察,我们尝试做了初步的尝试: 借鉴 Rust 和 WebAssembly 社区开发者的一些尝试,我们对 wasi-nn crate 中定义的unsafe 接口进行了抽象和安全封装,构建了 wasmedge-nn crate 原型。本文的后续部分将演示如何使用 wasmedge-nn crate 替换 wasi-nn crate,重新构建上一篇文章中所使用的道路分割 Wasm 推理模块。 Rust 社区中著名的图像处理库之一 image crate 提供了我们所需的图片预处理的基本能力;此外,由于其是 Rust 原生实现,所以基于这个库来构建我们需要的图像处理库是可以编译为 wasm 模块的。 下面,我们继续使用道路分割示例,具体演示一下我们的改进方案。wasmedge-nn crate 的安全接口 基于wasmedge-nn构建wasm推理模块 use std::env;

use wasmedge_nn::{

cv::image_to_bytes,

nn::{ctx::WasiNnCtx, Dtype, ExecutionTarget, GraphEncoding, Tensor},

};

fn main() -> Result<(), Box<dyn std::error::Error>> {

let args: Vec<String> = env::args().collect();

let model_xml_name: &str = &args[1];

let model_bin_name: &str = &args[2];

let image_name: &str = &args[3];

// 加载图片,并转换为字节序列

println!("Load image file and convert it into tensor ...");

let bytes = image_to_bytes(image_name.to_string(), 512, 896, Dtype::F32)?;

// 创建 Tensor 实例,包括数据、维度、类型等信息

let tensor = Tensor {

dimensions: &[1, 3, 512, 896],

r#type: Dtype::F32.into(),

data: bytes.as_slice(),

};

// 创建 WASI-NN Context 实例

let mut ctx = WasiNnCtx::new()?;

// 加载模型文件及其它推理过程需要的配置信息

println!("Load model files ...");

let graph_id = ctx.load(

model_xml_name,

model_bin_name,

GraphEncoding::Openvino,

ExecutionTarget::CPU,

)?;

// 初始化执行环境

println!("initialize the execution context ...");

let exec_context_id = ctx.init_execution_context(graph_id)?;

// 为执行环境提供输入

println!("Set input tensor ...");

ctx.set_input(exec_context_id, 0, tensor)?;

// 执行推理计算

println!("Do inference ...");

ctx.compute(exec_context_id)?;

// 获取推理计算的结果

println!("Extract result ...");

let mut out_buffer = vec![0u8; 1 * 4 * 512 * 896 * 4];

ctx.get_output(exec_context_id, 0, out_buffer.as_mut_slice())?;

// 导出计算结果到指定的二进制文件

println!("Dump result ...");

dump(

"wasinn-openvino-inference-output-1x4x512x896xf32.tensor",

out_buffer.as_slice(),

)?;

Ok(())

}import matplotlib.pyplot as plt

import numpy as np

# 读取保存推理结果的二进制文件,并将其转换为原始维度

data = np.fromfile("wasinn-openvino-inference-output-1x4x512x896xf32.tensor", dtype=np.float32)

print(f"data size: {data.size}")

resized_data = np.resize(data, (1,4,512,896))

print(f"resized_data: {resized_data.shape}, dtype: {resized_data.dtype}")

# 准备用于可视化的数据

segmentation_mask = np.argmax(resized_data, axis=1)

print(f"segmentation_mask shape: {segmentation_mask.shape}, dtype: {segmentation_mask.dtype}")

# 绘制并显示

plt.imshow(segmentation_mask[0])基于 image crate 的图像预处理函数 use image::{self, io::Reader, DynamicImage};

// 将图片文件转换为特定尺寸,并转换为指定类型的字节序列

pub fn image_to_bytes(

path: impl AsRef<Path>,

nheight: u32,

nwidth: u32,

dtype: Dtype,

) -> CvResult<Vec<u8>> {

// 读取图片

let pixels = Reader::open(path.as_ref())?.decode()?;

// 转换为特定的尺寸

let dyn_img: DynamicImage = pixels.resize_exact(nwidth, nheight, image::imageops::Triangle);

// 转换为BGR格式

let bgr_img = dyn_img.to_bgr8();

// 转换为指定类型的字节序列

let raw_u8_arr: &[u8] = &bgr_img.as_raw()[..];

let u8_arr = match dtype {

Dtype::F32 => {

// Create an array to hold the f32 value of those pixels

let bytes_required = raw_u8_arr.len() * 4;

let mut u8_arr: Vec<u8> = vec![0; bytes_required];

for i in 0..raw_u8_arr.len() {

// Read the number as a f32 and break it into u8 bytes

let u8_f32: f32 = raw_u8_arr[i] as f32;

let u8_bytes = u8_f32.to_ne_bytes();

for j in 0..4 {

u8_arr[(i * 4) + j] = u8_bytes[j];

}

}

u8_arr

}

Dtype::U8 => raw_u8_arr.to_vec(),

};

Ok(u8_arr)

}总结

![]() 开发技术

发布于:2022-08-14 15:46

|

阅读数:558

|

评论:0

开发技术

发布于:2022-08-14 15:46

|

阅读数:558

|

评论:0

QQ好友和群

QQ好友和群 QQ空间

QQ空间