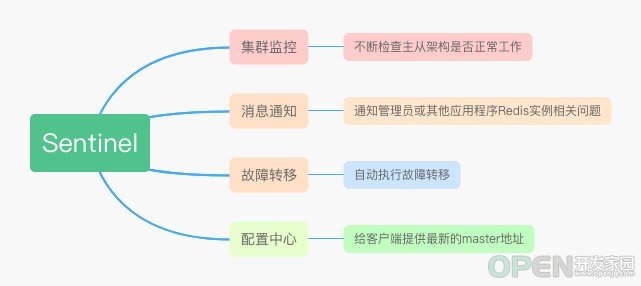

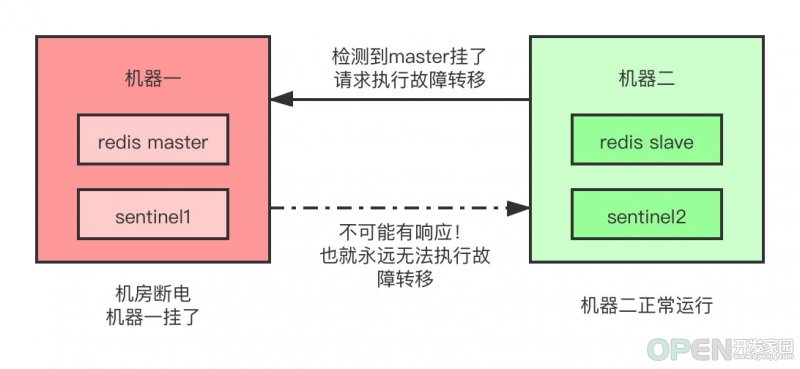

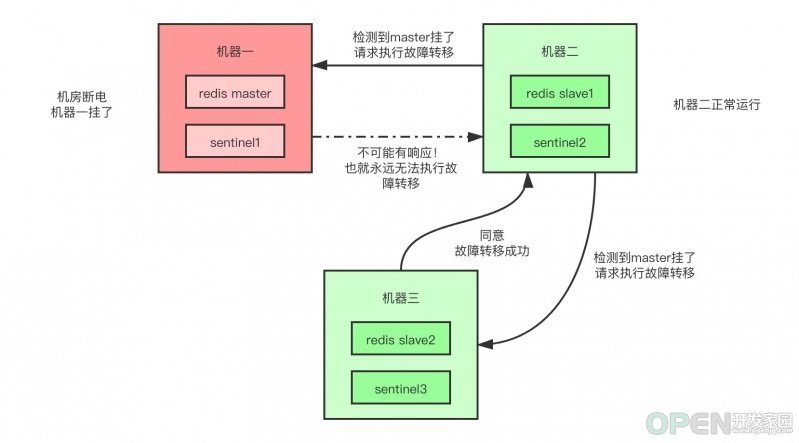

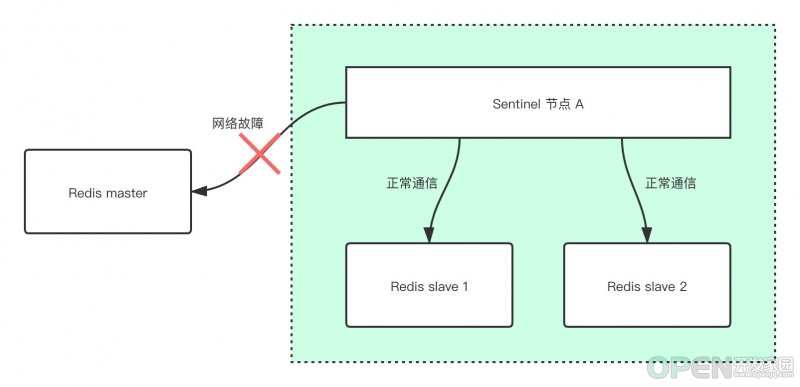

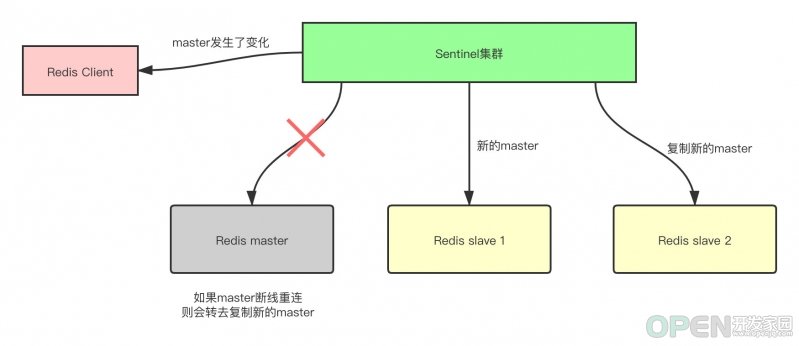

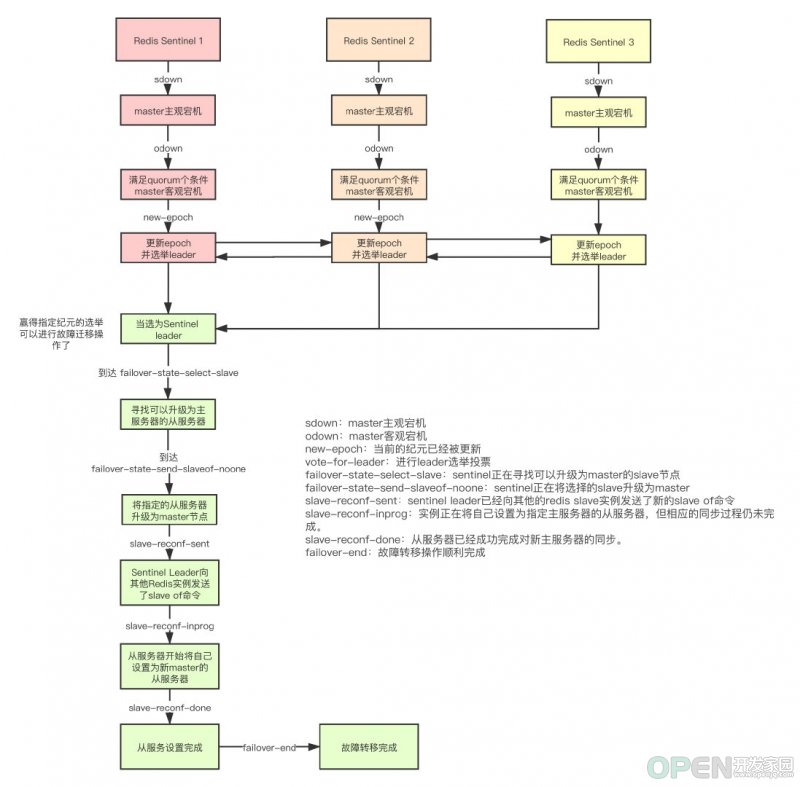

本篇博客会简单的介绍Redis的Sentinel相关的原理,同时也会在最后的文章给出硬核的 实战教程,让你在了解原理之后,能够实际上手的体验整个过程。 之前的文章聊到了Redis的主从复制,聊到了其相关的原理和缺点,具体的建议可以看看我之前写的文章Redis的主从复制。写能力 由于受到master单节点的资源限制是无法进行扩展的。Sentinel 功能概览 多个 Sentinel节点和多个 Redis节点。而每个Sentinel节点会对Redis节点和其余的Sentinel节点进行监控。主从 下的手动故障转移,Sentinel的故障转移是全自动的,无需 人工介入。Sentinel自身高可用 666,那我怎么知道满足它自身的高可用需要部署多少个Sentinel节点? 因为Sentinel本身也是分布式的,所以也需要部署多实例来保证自身集群的高可用,但是这个数量是有个最低的要求,最低需要3个 。我去,你说3个就3个?我今天偏偏就只部署2个 你别杠...等我说了为什么就必须要3个...大部分 的哨兵都同意才行,如果只有两个哨兵实例,正常运作还好,就像这样。其余哨兵节点 的同意,此时也永远 无法执行故障转移,那Sentinel岂不是成了一个摆设?不同的 机器上,如果所有的Sentinel节点都部署到了同一台机器上,那当这台机器挂了,整个Sentinel也就不复存在了。quorum&majority 大部分?大哥这可是要上生产环境,大部分这个数量未免也太敷衍了,咱就不能专业一点? 前面提到的大部分哨兵同意涉及到两个参数,一个叫quorum,如果Sentinel集群有quorum个哨兵认为master宕机了,就客观 的认为master宕机了。另一个叫majority...等等等等,不是已经有了一个叫什么quorum的吗?为什么还需要这个majority? 你能不能等我把话说完...判断 作用。而我们在实际的生产中,不是说只判断 master宕机就完了, 我们不还得执行故障转移 ,让集群正常工作吗?主观宕机&客观宕机 你刚刚是不是提到了客观宕机 ?笑死,难不成还有主观宕机这一说? Subjective Down,简称sdown ,主观的认为master宕机 Objective Down,简称odown ,客观的认为master宕机 主观 的认为这个Redis数据A节点sdown了。为什么是主观 ?我们得先知道什么叫主观未经分析推算,下结论、决策和行为反应,暂时不能与其他不同看法的对象仔细商讨,称为主观 。 简单来说,因为有可能只是 当前的Sentinel节点和这个A节点的网络通信有问题,其余的Sentinel节点仍然可以和A正常的通信。odown ,当大于等于了quorum 个Sentinel节点认为某个节点宕机了,我们就客观 的认为这个节点宕机了。故障转移 具体要执行些什么操作呢?我们通过一个图来看一下。硬核教程 硬核教程旨在用最快速的方法,让你在本地体验Redis主从架构和Sentinel集群的搭建,并体验整个故障转移的过程。 前置要求 安装了docker 安装了docker-compose 准备compose文件 $ tree .

.

├── redis

│ └── docker-compose.yml

└── sentinel

├── docker-compose.yml

├── sentinel1.conf

├── sentinel2.conf

└── sentinel3.conf

2 directories, 5 files搭建Redis主从服务器 version: '3'

services:

master:

image: redis

container_name: redis-master

ports:

- 6380:6379

slave1:

image: redis

container_name: redis-slave-1

ports:

- 6381:6379

command: redis-server --slaveof redis-master 6379

slave2:

image: redis

container_name: redis-slave-2

ports:

- 6382:6379

command: redis-server --slaveof redis-master 6379以上的命令,简单解释一下slaveof 然后用命令行进入当前目录,直接敲命令docker-compose up即可,剩下的事情交给docker-compose去做就好,它会把我们所需要的节点全部启动起来。搭建Sentinel集群 version: '3'

services:

sentinel1:

image: redis

container_name: redis-sentinel-1

ports:

- 26379:26379

command: redis-sentinel /usr/local/etc/redis/sentinel.conf

volumes:

- ./sentinel1.conf:/usr/local/etc/redis/sentinel.conf

sentinel2:

image: redis

container_name: redis-sentinel-2

ports:

26380:26379

command: redis-sentinel /usr/local/etc/redis/sentinel.conf

volumes:

- ./sentinel2.conf:/usr/local/etc/redis/sentinel.conf

sentinel3:

image: redis

container_name: redis-sentinel-3

ports:

- 26381:26379

command: redis-sentinel /usr/local/etc/redis/sentinel.conf

volumes:

- ./sentinel3.conf:/usr/local/etc/redis/sentinel.conf

networks:

default:

external:

name: redis_default同样在这里解释一下命令 建立三份一模一样的文件,分别命名为sentinel1.conf、sentinel2.conf和sentinel3.conf。其内容如下:port 26379

<p>dir "/tmp"</p>

<p>sentinel deny-scripts-reconfig yes</p>

<p>sentinel monitor mymaster 172.28.0.3 6379 2</p>

<p>sentinel config-epoch mymaster 1</p>

sentinel leader-epoch mymaster 1手动模拟master挂掉 docker-compose pause master10秒 之后,就可以看到sentinel这边输出了如下的日志。redis-sentinel-2 | 1:X 07 Dec 2020 01:58:05.459 # +sdown master mymaster 172.28.0.3 6379

<p>......</p>

<p>......</p>

<p>......</p>

redis-sentinel-1 | 1:X 07 Dec 2020 01:58:06.932 # +switch-master mymaster 172.28.0.3 6379 172.28.0.2 6379得得得,你干什么就甩一堆日志文件上来?凑字数?你这样鬼能看懂? 的确,光从日志文件一行一行的看,就算是我自己过两周再来看,也是一脸懵逼。日志文件完整了描述了整个Sentinel集群从开始执行故障转移到最终执行完成的所有细节,但是在这里直接放出来不方便大家的理解。role:master

<p>connected_slaves:1</p>

<p>slave0:ip=172.28.0.4,port=6379,state=online,offset=18952,lag=0</p>

<p>master_replid:f0bf5d1c843ec3ab005c5ac2b864f7ffdc6a8217</p>

<p>master_replid2:72c43e1f9c05d4b08bea6bf9b2549997587e261c</p>

<p>master_repl_offset:18952</p>

<p>second_repl_offset:16351</p>

<p>repl_backlog_active:1</p>

<p>repl_backlog_size:1048576</p>

<p>repl_backlog_first_byte_offset:1</p>

repl_backlog_histlen:18952master ,与其相连接的slave节点只有1个,因为现在的原master 还没有启动起来,总共存活的只有2个实例。原master重启启动 $ docker exec -it f70a9d9809bc1e924a5be0135888067ad3eb16552f9eaf82495e4c956b456cd9 /bin/sh; exit<br><h1>redis-cli</h1><br>

127.0.0.1:6379> info replication<br><h1>Replication</h1><br>

<p>role:slave</p>

<p>master_host:172.28.0.2</p>

<p>master_port:6379</p>

<p>master_link_status:up</p>

......# Replication

<p>role:master</p>

<p>connected_slaves:2</p>

<p>slave0:ip=172.28.0.4,port=6379,state=online,offset=179800,lag=0</p>

<p>slave1:ip=172.28.0.3,port=6379,state=online,offset=179800,lag=1</p>

......connected_slaves 变成了2,且原master 172.28.0.3被清晰的标注为了slave1,同样与我们开篇和图中所讲的原理相符合。本片文章已放到我的 Github github.com/sh-blog 中,欢迎 Star。微信搜索关注【SH的全栈笔记 】,回复【队列 】获取MQ学习资料,包含基础概念解析和RocketMQ详细的源码解析,持续更新中。点个赞 ,关个注 ,分个享 ,留个言 。

![]() 数据库

发布于:2021-07-16 19:46

|

阅读数:412

|

评论:0

数据库

发布于:2021-07-16 19:46

|

阅读数:412

|

评论:0

QQ好友和群

QQ好友和群 QQ空间

QQ空间