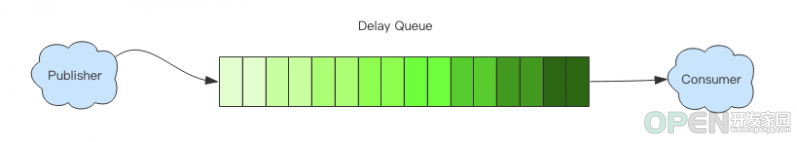

def get_user(user_id): user = redis.get(user_id) if not user: user = db.get(user_id) redis.setex(user_id, ttl, user) // 设置缓存过期时间 return userdef save_user(user): redis.setex(user.id, ttl, user) // 设置缓存过期时间 db.save_async(user) // 异步写数据库# 加锁set lock:$user_id owner_id nx ex=5# 释放锁if redis.call("get", KEYS[1]) == ARGV[1] then return redis.call("del", KEYS[1])else return 0end# 等价于del_if_equals lock:$user_id owner_id# 生产延时消息zadd(queue-key, now_ts+5, task_json)# 消费延时消息while True: task_json = zrevrangebyscore(queue-key, now_ts, 0, 0, 1) if task_json: grabbed_ok = zrem(queue-key, task_json) if grabbed_ok: process_task(task_json) else: sleep(1000) // 歇 1slocal res = nillocal tasks = redis.pcall("zrevrangebyscore", KEYS[1], ARGV[1], 0, "LIMIT", 0, 1)if #tasks > 0 then local ok = redis.pcall("zrem", KEYS[1], tasks[1]) if ok > 0 then res = tasks[1] endend

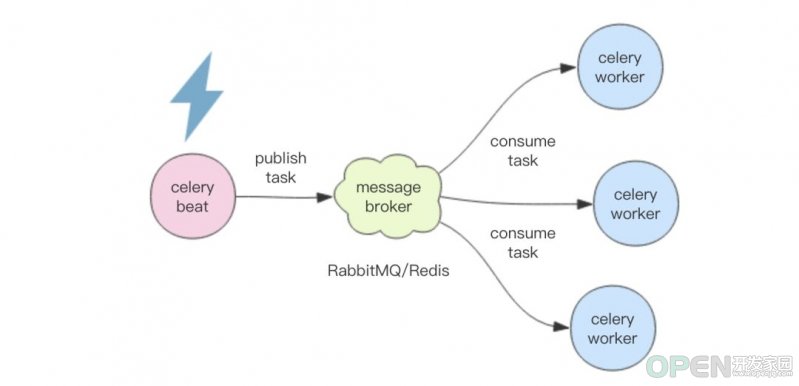

图片

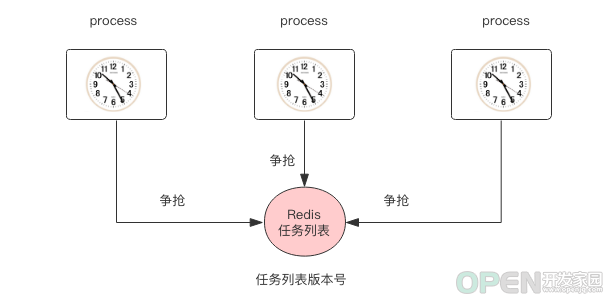

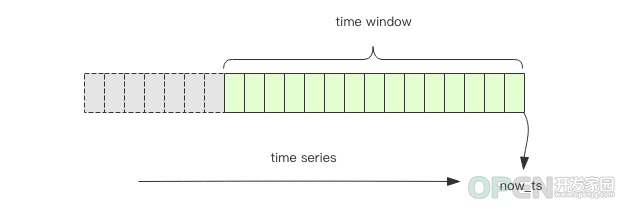

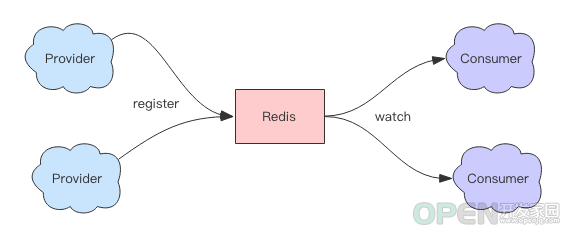

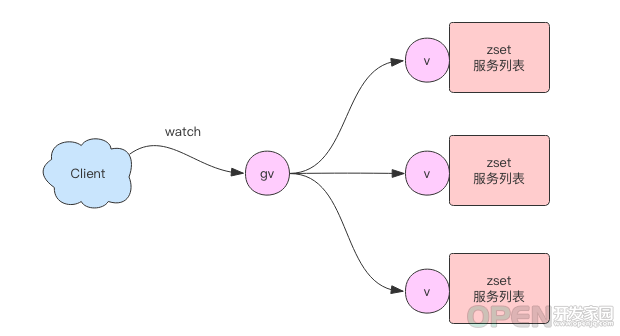

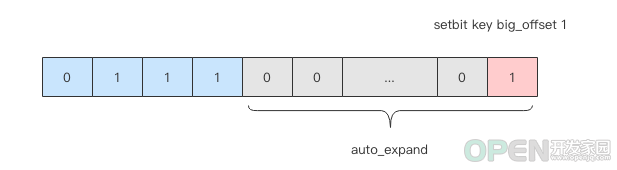

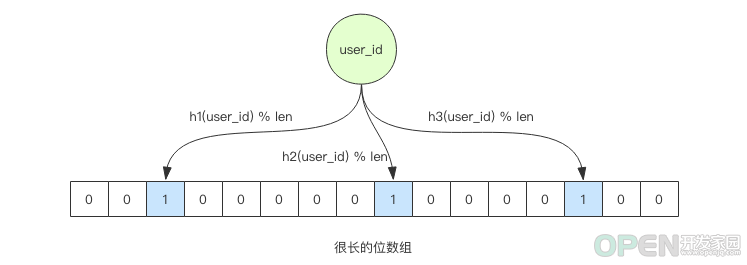

# 注册定时任务hset tasks name trigger_rule# 获取定时任务列表hgetall tasks# 争抢任务set lock:${name} true nx ex=5# 任务列表变更(滚动升级)# 轮询版本号,有变化就重加载任务列表,重新调度时间有变化的任务set tasks_version $new_versionget tasks_versionLife is Short,I use Redishttps://github.com/pyloque/taskino# 下面的代码控制用户的 ugc 行为为每小时最多 N 次hist_key = "ugc:${user_id}"with redis.pipeline() as pipe: # 记录当前的行为 pipe.zadd(hist_key, ts, uuid) # 保留1小时内的行为序列 pipe.zremrangebyscore(hist_key, 0, now_ts - 3600) # 获取这1小时内的行为数量 pipe.zcard(hist_key) # 设置过期时间,节约内存 pipe.expire(hist_key, 3600) # 批量执行 _, _, count, _ = pipe.exec() return count > Nzadd service_key heartbeat_ts addrzrem service_key addrzremrangebyscore service_key 0 now_ts - 30 # 30s 都没来心跳if zadd() > 0 || zrem() > 0 || zremrangebyscore() > 0: incr service_version_keyhset sign:${user_id} 2019-01-01 1hset sign:${user_id} 2019-01-02 1hset sign:${user_id} 2019-01-03 2...# 记录用户pfadd sign_uv_${day} user_id# 获取记录数量pfcount sign_uv_${day}def get_user_state0(user_id): state = cache.get(user_id) if not state: state = db.get(user_id) or {} cache.set(user_id, state) return statedef save_user_state0(user_id, state): cache.set(user_id, state) db.set_async(user_id, state)def get_user_state(user_id): exists = bloomfilter.is_user_exists(user_id) if not exists: return {} return get_user_state0(user_id)def save_user_state(user_id, state): bloomfilter.set_user_exists(user_id) save_user_state0(user_id, state)

![]() 数据库

发布于:2021-07-01 17:34

|

阅读数:285

|

评论:0

数据库

发布于:2021-07-01 17:34

|

阅读数:285

|

评论:0

QQ好友和群

QQ好友和群 QQ空间

QQ空间