[通信技术]

技术分享| RTC通讯中常用的音频格式

发布于:2021-11-17 10:17

|

阅读数:499

|

评论:0

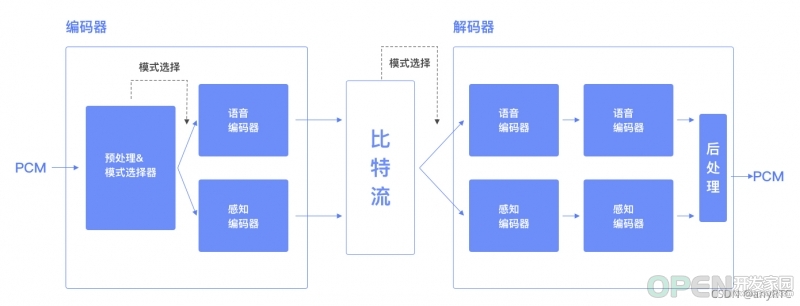

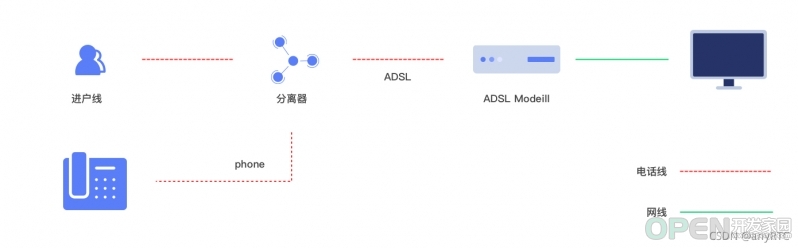

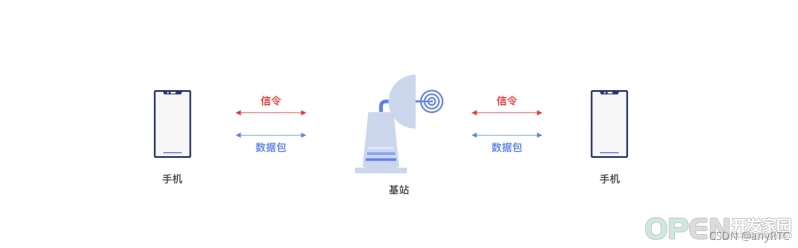

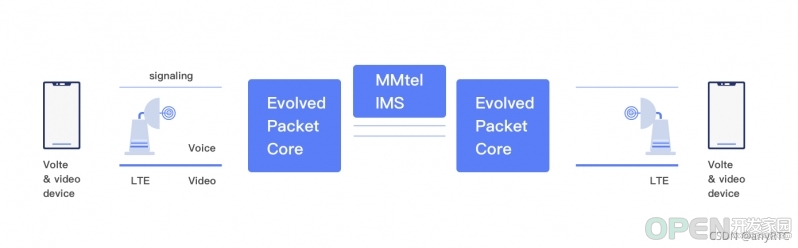

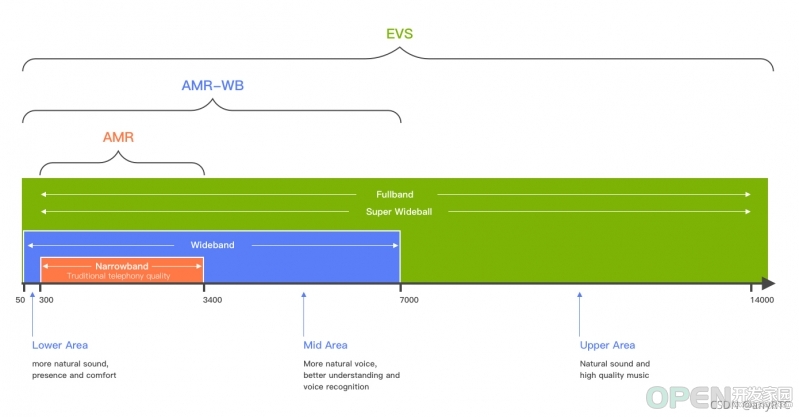

上次我们介绍了RTC通讯中常用的图像格式,这次我们来介绍一下RTC通讯中常用的音频格式。一,概述 二,常用的音频格式 1、MP3 ——没有比这更熟悉的名字:MPEG音频文件的压缩是一种有损压缩,MPEG3音频编码具有10:1~12:1的高压缩率,同时基本保持低音频部分不失真,但是牺牲了声音文件中12KHz到16KHz高音频这部分的质量来换取文件的尺寸,相同长度的音乐文件,用 .mp3 格式来储存,一般只有 .wav 文件的1/10,因而音质要次于CD格式或WAV格式的声音文件。2、PCM ——最常用的音频格式:PCM中文称脉冲编码调制(Pulse Code Modulation),是70年代末发展起来的,记录媒体之一的CD,在80年代初由飞利浦和索尼公司共同推出。脉码调制的音频格式也被DVD-A所采用,它支持立体声和5.1环绕声,1999年由DVD讨论会发布和推出的。脉冲编码调制的比特率,从14-bit发展到16-bit、18-bit、20-bit直到24-bit;采样频率从44.1kHz发展到192kHz。PCM脉码调制这项技术可以改善和提高的方面则越来越来小。3、AMR ——AMR全称Adaptive Multi-Rate,自适应多速率编码,主要用于移动设备的音频,压缩比比较大,但相对其他的压缩格式质量比较差,由于多用于人声,通话。4、Opus ——WebRTC的首选音频:集成了两种声音编码的技术:以语音编码为导向的SILK和低延迟的CELT。Opus可以无缝调节高低比特率。在编码器内部它在较低比特率时使用线性预测编码在高比特率时候使用变换编码(在高低比特率交界处也使用两者结合的编码方式)。Opus具有非常低的算法延迟(默认为22.5 ms),非常适合用于低延迟语音通话的编码,像是网上上的即时声音流、即时同步声音旁白等等,此外Opus也可以透过降低编码码率,达成更低的算法延迟,最低可以到5 ms。在多个听觉盲测中,Opus都比MP3、AAC、HE-AAC等常见格式,有更低的延迟和更好的声音压缩率。5、AAC ——直播场景的常胜将军:AAC实际上是高级音频编码的缩写,苹果ipod、诺基亚手机也支持AAC格式的音频文件。AAC是由Fraunhofer IIS-A、杜比和AT&T共同开发的一种音频格式,它是MPEG-2规范的一部分。AAC所采用的运算法则与MP3的运算法则有所不同,AAC 通过结合其他的功能来提高编码效率。AAC的音频算法在压缩能力上远远超过了以前的一些压缩算法(比如MP3等)。它还同时支持多达48个音轨、15个低频音轨、更多种采样率和比特率、多种语言的兼容能力、更高的解码效率。总之,AAC可以在比MP3文件缩小30%的前提下提供更好的音质。6、Lyra 一一人工智能的新产物:Lyra是google 提出的一种基于深度学习的低码率语音编解码器,在google Duo中使用,能够实现每秒3kb的网络下清晰地聊天。将数据分为40ms每帧,提取特征(log mel spectrograms)压缩,在decoder部分一个生成模型将特征转为语音信号。与传统参数音频编解方法混合激励线性预测(MELP通过计算和传输线性预测系数来提高效率)结构很相似,但是传统参数音频编解码生成的数据音质比较差,而生成模型(如WaveNet)已经被证明是可以实现从特征生成多个语音采样点。(WaveNetEQ 利用生成模型实现丢包补偿)。 MBE(多频带激励,将频域划分为相等大小的频带,传输频带的能量,并确定每个频带的有声/无声信息)的解码器Griffin-Lim算法是在仅提供能量而没有相位信息的情况下恢复信号的方法,与WaveNet系列算法相比,Griffin-Lim算法在音质方面要差很多。但是WaveNet等方法计算量较大,Lyra中使用超过70种语言的数千小时的数据来训练WaveRNN的变种模型来实现较高的音质和较低的复杂度。三,声音是如何在RTC中传输的 四,总结 </div>

<div id="asideoffset"></div>

免责声明:

1. 本站所有资源来自网络搜集或用户上传,仅作为参考不担保其准确性!

2. 本站内容仅供学习和交流使用,版权归原作者所有!© 查看更多

3. 如有内容侵害到您,请联系我们尽快删除,邮箱:kf@codeae.com

![]() 网络安全

发布于:2021-11-17 10:17

|

阅读数:499

|

评论:0

网络安全

发布于:2021-11-17 10:17

|

阅读数:499

|

评论:0

QQ好友和群

QQ好友和群 QQ空间

QQ空间