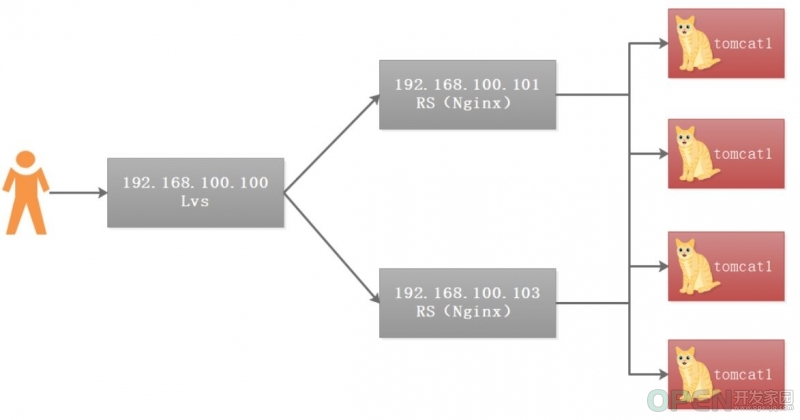

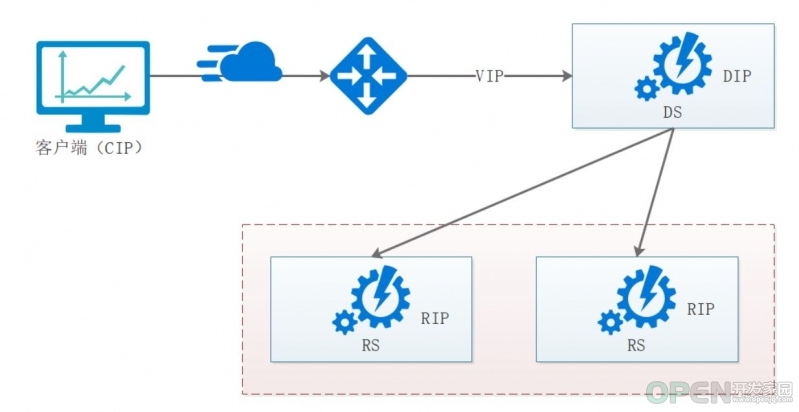

本文主要介绍了使用Lvs+Nginx集群搭建高并发架构的实现示例,文中通过示例代码介绍的非常详细,具有一定的参考价值,感兴趣的小伙伴们可以参考一下目录 1. lvs介绍 2. lvs 负载均衡模式 3. lvs dr模式配置3.1 vip配置 3.2 lvs集群管理工具安装 3.3 地址解析协议 3.4 集群配置 1. lvs介绍 1:ds:director server。虚拟服务,负责调度

2:rs:real server。后端真实的工作服务器。

3:vip:向外部直接面向用户请求,作为用户请求的目标的ip地址

4:dip:director server ip,ds的ip

5:rip:real server ip,后端服务器的ip地址

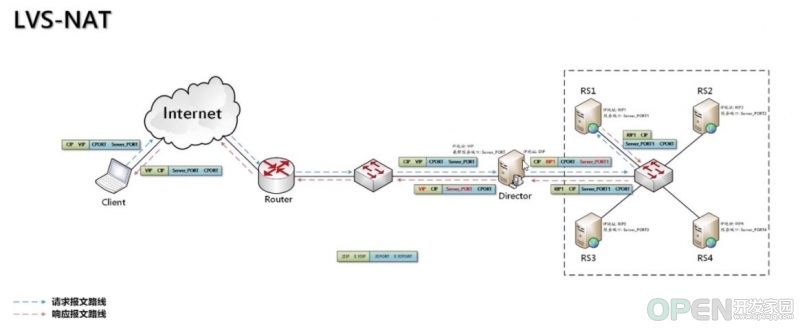

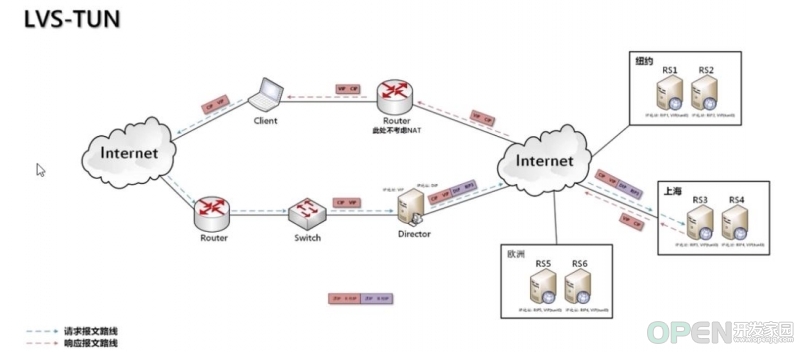

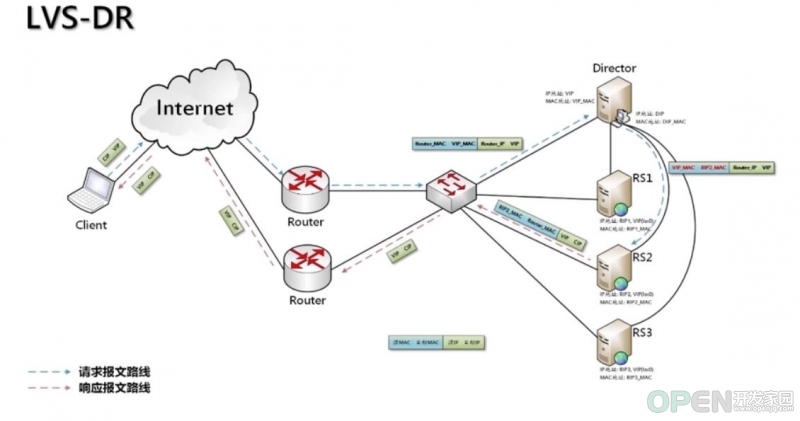

6:cip:client ip,访问客户端的ip地址2. lvs 负载均衡模式 2.1 nat 2.2 tun 2.3 dr模式 3. lvs dr模式配置 1:192.168.183.133 (ds) 192.168.183.150 对外提供服务

2:192.168.183.134 (rs) 192.168.183.150 真实服务处理业务流程

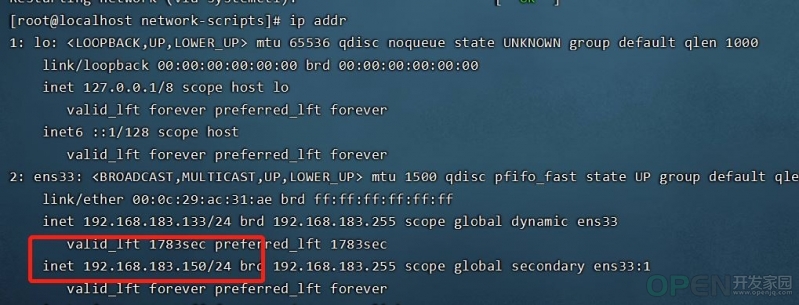

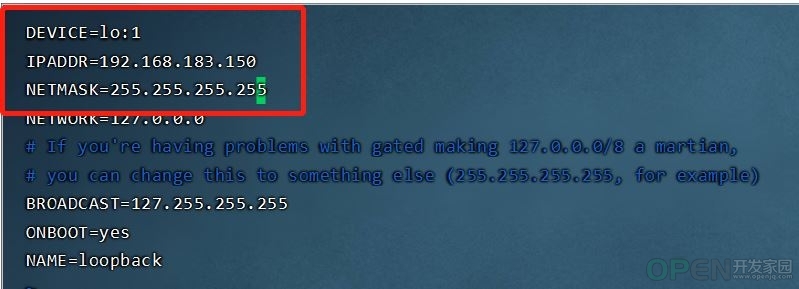

3:192.168.183.135 (rs) 192.168.183.150 真实服务处理业务流程3.1 vip配置 systemctl stop networkmanager

systemctl disable networkmanagerbootproto=static

device=ens33:1

onboot=yes

ipaddr=192.168.183.150

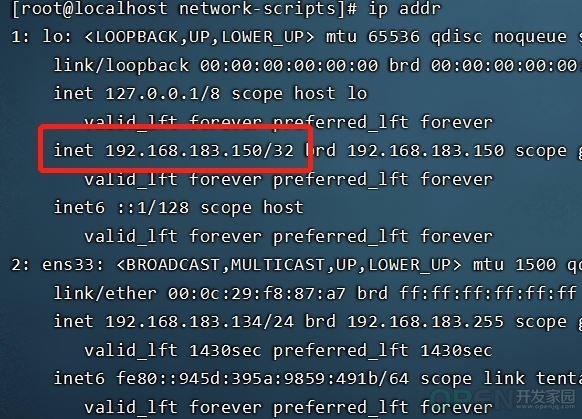

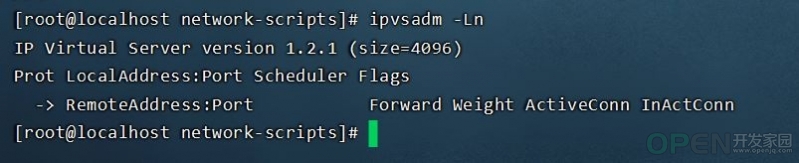

netmask=255.255.255.0service network restartifup lo3.2 lvs集群管理工具安装 yum install ipvsadmipvsadm -ln3.3 地址解析协议 net.ipv4.conf.all.arp_ignore = 1

net.ipv4.conf.default.arp_ignore = 1

net.ipv4.conf.lo.arp_ignore = 1

net.ipv4.conf.all.arp_announce = 2

net.ipv4.conf.default.arp_announce = 2

net.ipv4.conf.lo.arp_announce = 2sysctl -proute add -host 192.168.183.150 dev lo:13.4 集群配置 ipvsadm -a:用于创建集群

ipvsadm -e:用于修改集群

ipvsadm -d:用于删除集群

ipvsadm -c:用于清除集群数据

ipvsadm -r:用于重置集群配置规则

ipvsadm -s:用于保存修改的集群规则

ipvsadm -a:用于添加一个rs节点

ipvsadm -e:用于修改一个rs节点

ipvsadm -d:用于删除一个rs节点ipvsadm -a -t 192.168.183.150:80 -s rr-a:添加集群配置 -t:tcp请求地址(vip) -s:负载均衡算法 ipvsadm -a -t 192.168.183.150:80 -r 192.168.183.134:80 -g

ipvsadm -a -t 192.168.183.150:80 -r 192.168.183.135:80 -g-a:给集群添加一个节点 -t:指定vip地址 -r:指定real server地址 -g:表示lvs的模式为dr模式 ipvsadm --set 2 2 2CodeAE代码之家 以前的文章或继续浏览下面的相关文章希望大家以后多多支持CodeAE代码之家!

![]() web服务器

发布于:2022-01-20 10:12

|

阅读数:691

|

评论:0

web服务器

发布于:2022-01-20 10:12

|

阅读数:691

|

评论:0

QQ好友和群

QQ好友和群 QQ空间

QQ空间