MySQL 基础建设之硬盘篇 一、硬件选型 1. 节点统计 2. 数据量统计 某机房

功能业务

data空间使用情况

slow log空间使用情况

bin_log目录使用情况

某同步系统|主库

192G

4.9G

3.2G

某同步系统|从库

281G

43M

3.2G

某api服务|主库

6.2G

300M

3G

某api服务|从库

6.6G

13M

3G

综合业务服务|主库

2.9G

2M

4.8G

综合业务服务|从库

1.4G

92M

3.2G

账号服务 | 主库

4.7G

207M

44G

账号服务 | 从库

43G

1M

58M

积分服务 | 主库

1.5G

200M

11G

积分服务 | 从库

2.2G

20M

11G

游戏 | 主库

1.4G

1.8G

753M

游戏 | 从库

1.4G

115M

776M

微博业务 | 主库

2.0G

2.5G

674M

微博业务 | 从库

5.5G

8G

661M

3. 硬件选型 二、一个坑:压力测试 1. 压测工具选择 不要模仿,之前就是直接复制 -rw=randwrite -bs=4k -size=500G -numjobs=64 -runtime=20 -group_reporting -name=test-rand-writellbw=74239KB/s, iops=18559 , runt= 20028msec2. 压测工具命令各参数 -rw=randwrite -bs=4k -size=500G -numjobs=64 -runtime=20 -group_reporting三、缓存、深度及并发

1. 缓存 2.IO 深度和并发 -iodepth 64 direct如果是影响 CPU 的话,那么应该是数字越小,CPU消耗越大。因为数字越小,CPU 要批量往硬盘发数据的次数就是越多,但是数字越大,积压的内存理论上应该越多

同时,硬盘一次能接收的数量总是有个极限的,所以应该是接近这个极限比较好,具体这么极限怎么计算,可能很难。可能要考虑到 CPU 内存,硬盘缓冲等一系列因素

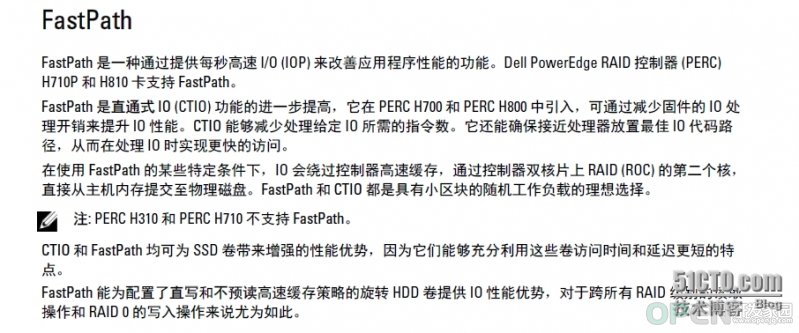

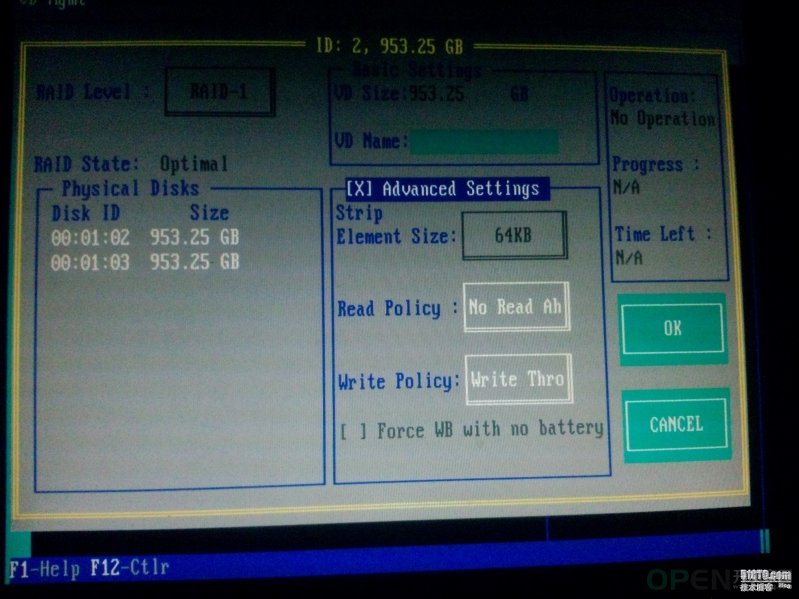

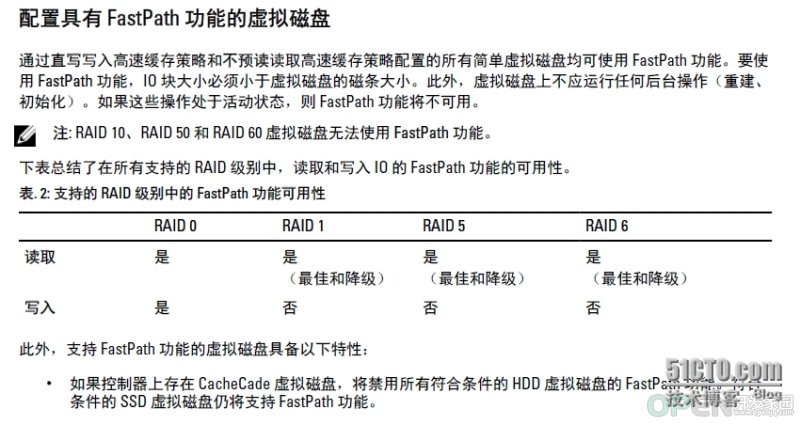

四、RAID卡特性 配置 FastPath 会带来 IO 方面 100% 的性能提升1 、参考其他人的压测经验 这里不得不说一下,作者使用了RAID10来做压力测试,前期iops达到了2.6W,这里提到了 发现了H710P的FastPATH功能,专门为SSD的使用

本 文来 自 htt p:/ /yiji u.blog.51cto.com 盗贴 可耻 文中提到未压缩的压测结果: 512kb 压测对比 总结: 因此,文章中又提到,不是采用了单块大容量的SSD,而是选择了两个小容量的ssd做为RAID 0 效果会更佳,(这里也提到了用容量小的SSD做RAID效果会更好) 五、设置FastPATH 1.FastPATH 的作用 2. 开启FastPATH

Fastpath I/O is a method of increasing Input/Output Operations per Second (IOPS) by using the 2nd core of the PERC (Gemini core) to directly execute I/O and completely bypass caching. Fastpath I/O is most beneficial for SSD disks. Fastpath I/O is not available on H710 controller, only available on H710P and H810 controllers. Fastpath I/O is automatically available on eligible VDs. Fastpath eligible VDs should have the following properties:

Write-Through No Read Ahead No Background Operation (e.g. Background Initialization, Patrol Read or Consistency Check ) in progress. ctrl+r VD enter write policy read policy

3. 回写、直写和预读、非预读 关于write back 和Write Through 回写、Write Back 直写、Write Through 预读:

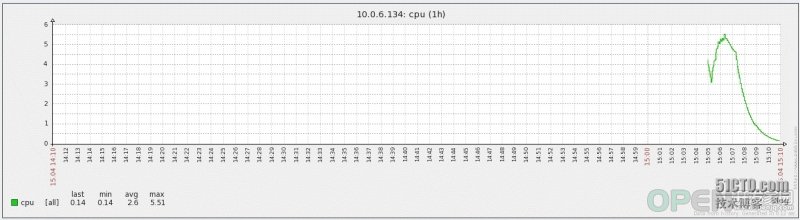

六、埋坑:还是压力测试 了解了上面所有的知识点及之间的调度关系,接下来再进行压力测试,但是有个地方很担心,当发压力的时候,是否磁盘还没走到顶,CPU 已经走到顶了。这里借助了zabbix进行对系统进行监控 将出更新设置为1秒一次,因为只有2台机器

本文来 自 ht~t p://yi~ji~u. bl~og .51~cto.co~m ~盗贴 可耻

进行64 iodepth 的随机写和顺序写,结果如下:

进行了4个线程,随机写分别都是5200,4线程以4kb的写入,那就是一共 28k

平均下来 随机读的iops,68000左右。那么与官方手册上说明的是一致了

压测结果统计

读/写

IOPS

随机写

5200

顺序写

18512

随机读

68000

以上只对RAID1进行说明,具体怎样还需要实际去测试七、RAID选型 1.FastPATH 特性及生效范围

2. 选型 本 文来 自 ht~t p://yi~ji~u.bl~og.51~ct~o.co~m ~盗贴 可耻 八、寿命问题 但是 RAID 1 也会 。

![]() 数据库

发布于:2021-07-03 21:43

|

阅读数:608

|

评论:0

数据库

发布于:2021-07-03 21:43

|

阅读数:608

|

评论:0

QQ好友和群

QQ好友和群 QQ空间

QQ空间