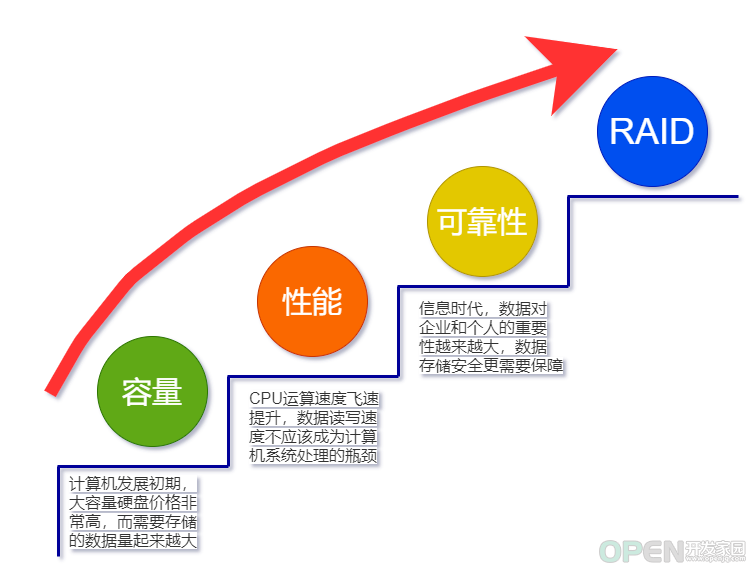

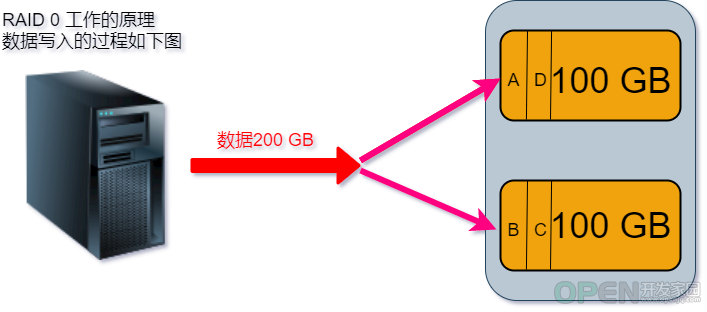

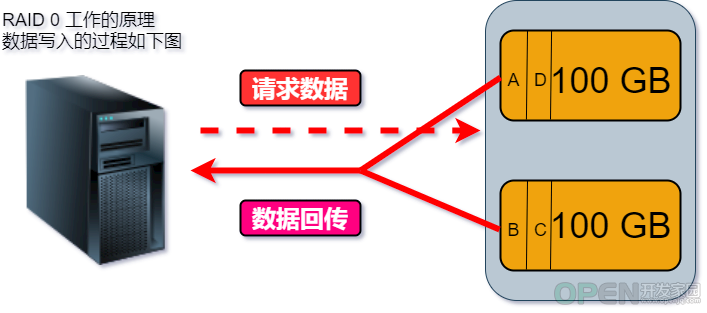

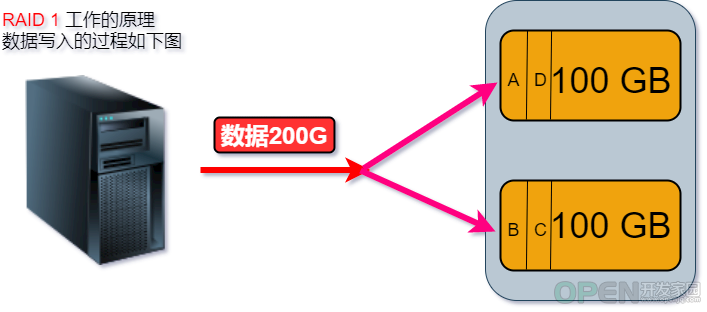

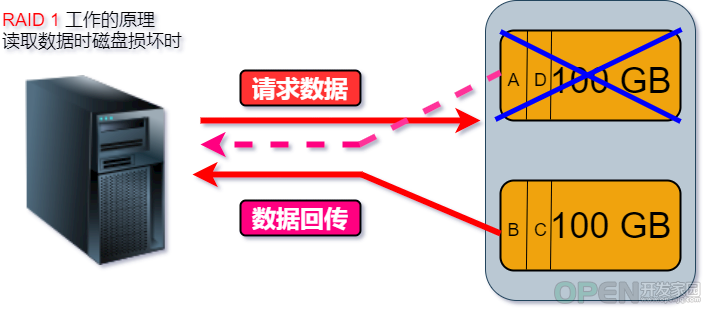

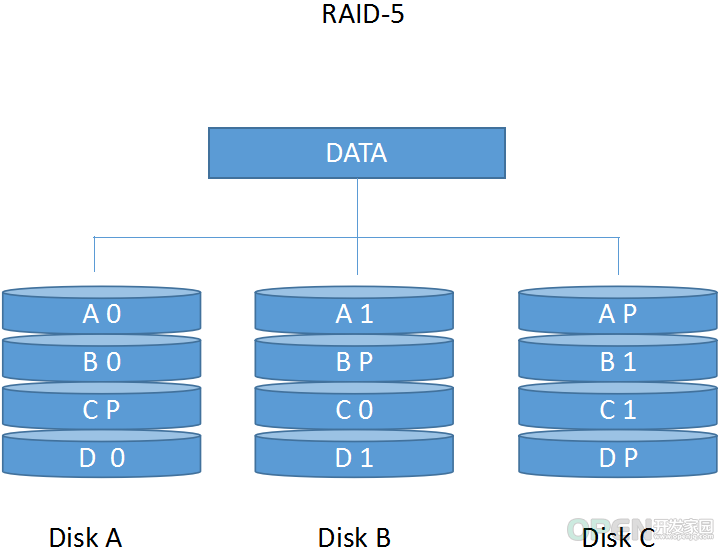

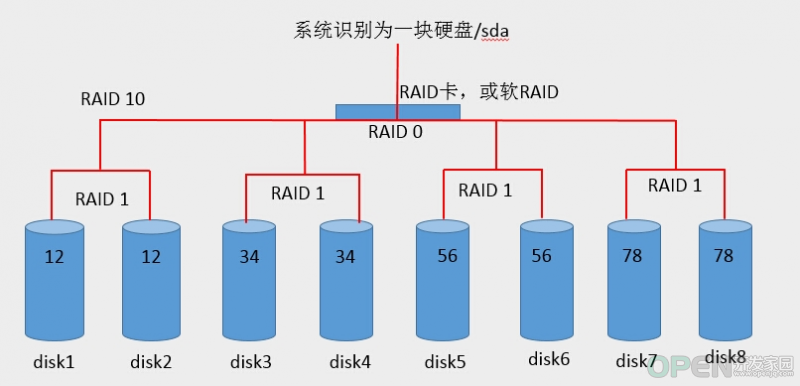

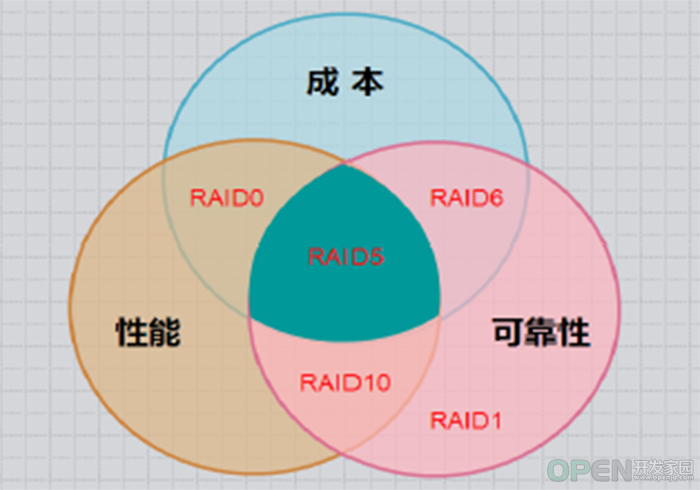

第十四章 RAID磁盘阵列的原理与搭建 本节所讲内容: 14.1 RAID 概念 企业级 RAID 0 1 5 10 的工作原理 14.2 RAID 0 1 5 10 搭建及使用 删除 RAID 及注意事项 14.3 实战 企业中硬件 raid5 的配置 14.1 RAID 概念-企业级 RAID-0-1-5-10 的工作原理 14.1.1 RAID 几种常见的类型 14.1.2 RAID-0 的工作原理 14.1.3 RAID-1 14.1.4 RAID-5 14.1.5 嵌套 RAID 级别 RAID-10 镜像+条带 几个方案对比下来, RAID5 是最适合的 ,如下图: 14.1.6 RAID 硬盘失效处理 热插拔:HotSwap 14.2 RAID-0-1-5-10 搭建及使用-删除 RAID 及注意事项 14.2.1 RAID 的实现方式 14.2.2 创建 RAID0 1、创建 raid0 [root@Centos83 ~]# yum -y install mdadm

[root@Centos83 ~]# mdadm -C -v /dev/md0 -l 0 -n 2 /dev/sdb /dev/sdc-C 创建 -v 详细信息 -l 阵列级别 -n 阵列成员数量

mdadm: chunk size defaults to 512K

mdadm: partition table exists on /dev/sdb

mdadm: partition table exists on /dev/sdb but will be lost or

meaningless after creating array

Continue creating array? y

mdadm: Defaulting to version 1.2 metadata

mdadm: array /dev/md0 started.

[root@Centos83 ~]# mdadm -Ds # -D 打印阵列设备详细信息 s 得到阵列缺失信息

ARRAY /dev/md0 metadata=1.2 name=Centos83:0 UUID=001930e2:b2f8a172:05f69ea7:ac8ed7b52、 查看阵列信息 [root@Centos83 ~]# mdadm -Ds # -D 打印阵列设备详细信息 s 得到阵列缺失信息

ARRAY /dev/md0 metadata=1.2 name=Centos83:0 UUID=001930e2:b2f8a172:05f69ea7:ac8ed7b5

[root@Centos83 ~]# mdadm -D /dev/md0

/dev/md0:

Version : 1.2

Creation Time : Wed Jul 14 12:08:24 2021

Raid Level : raid0

Array Size : 41908224 (39.97 GiB 42.91 GB)

Raid Devices : 2 #39.97 按照 1024 计算,42.92 按照 1000 计算

Total Devices : 2

Persistence : Superblock is persistentState : clean

Active Devices : 2Layout : -unknown-

Chunk Size : 512K #chunk 是 raid 中最小的存储单位Name : Centos83:0 (local to host Centos83)

UUID : 001930e2:b2f8a172:05f69ea7:ac8ed7b5

Events : 03、 对创建的 RAID0 进行文件系统创建并挂载 [root@Centos83 ~]# mkfs.xfs /dev/md0

[root@Centos83 ~]# mkdir /raid0

[root@Centos83 ~]# mount /dev/md0 /raid0

[root@Centos83 ~]# df -Th /raid0/

文件系统 类型 容量 已用 可用 已用% 挂载点

/dev/md0 xfs 40G 319M 40G 1% /raid0

[root@Centos83 ~]# echo raid > /raid0/raid.txt

[root@Centos83 ~]# cat /raid0/raid.txt

raid4、 开机自动挂载 [root@Centos83 ~]# blkid /dev/md0 # 查看 md0 UUID

/dev/md0: UUID="1e49efcb-9b7e-415a-8b05-a04bbb496a9a" BLOCK_SIZE="512" TYPE="xfs"

[root@Centos83 ~]# echo "UUID=1e49efcb-9b7e-415a-8b05-a04bbb496a9a /raid0 xfs defaults 0 0" >> /etc/fstab # 把 md0 挂载信息添加到开机挂载14.2.3 创建 RAID1 实验内容如下: 1)创建 RAID1 2)添加 1 个热备盘 3)模拟磁盘故障,自动顶替故障盘 4)从 raid1 中移出故障盘 [root@Centos83 ~]# mdadm -C -v /dev/md1 -l 1 -n 2 -x 1 /dev/sd[d,e,f]

# -C 创建 -v 详细信息 -l 阵列级别 -n 阵列成员数量 -x 阵列备用盘数量Version : 1.2

Creation Time : Wed Jul 14 12:28:48 2021

Raid Level : raid1

Array Size : 20954112 (19.98 GiB 21.46 GB)

Used Dev Size : 20954112 (19.98 GiB 21.46 GB)

Raid Devices : 2

Total Devices : 3

Persistence : Superblock is persistentState : clean, resyncing

Active Devices : 2Name : Centos83:1 (local to host Centos83)

UUID : 30d89efc:11eaa0f0:c032179e:f6b0cfd8

Events : 15#模拟损坏 [root@Centos83 ~]# mdadm -D /dev/md1 # -D 打印阵列设备详细信息

[root@Centos83 ~]# mdadm /dev/md1 -f /dev/sde # -f 将设备状态设为故障

[root@Centos83 ~]# mdadm -D /dev/md1

Number Major Minor RaidDevice State

0 8 48 0 active sync /dev/sdd

2 8 80 1 spare rebuilding /dev/sdf

1 8 64 - faulty /dev/sde[root@Centos83 ~]# mdadm -Dsv /etc/mdadm.conf # -D 打印阵列设备详细信息 s 得到阵列缺失信息 v

[root@Centos83 ~]# ls /raid1/ # 数据正常,没有丢失

passwd[root@Centos83 ~]# mdadm -r /dev/md1 /dev/sde # -r 移除损坏的设备

mdadm: hot removed /dev/sde from /dev/md1

[root@Centos83 ~]# mdadm -D /dev/md1 # 已经没有热备盘了,添加一块新热备盘

…………

Number Major Minor RaidDevice State

0 8 48 0 active sync /dev/sdd

2 8 80 1 active sync /dev/sdf

[root@Centos83 ~]# mdadm -a /dev/md1 /dev/sde # -a 添加设备到阵列

mdadm: added /dev/sde

[root@Centos83 ~]# mdadm -D /dev/md1 # 查看 sde又添加回来了

Number Major Minor RaidDevice State

0 8 48 0 active sync /dev/sdd

2 8 80 1 active sync /dev/sdf

3 8 64 - spare /dev/sde14.2.4 创建 RAID5 实验环境: 1)创建 RAID5, 添加 1 个热备盘,指定 chunk 大小为 32K -x 指定阵列中备用盘的数量 -c 或--chunk= 设定阵列的块 chunk 块大小 ,单位为 KB (普通文件就默认就可以,如果存储大文件就调大些,如果存储小文件就调小些,这里 chunk 就类似簇,块一样的概念,是阵列的最小存储单位) 2)停止阵列,重新激活阵列 3)使用热备盘,扩展阵列容量,从 3 个磁盘扩展到 4 个 [root@Centos83 ~]# mdadm -C -v /dev/md5 -l 5 -n 3 -x 1 -c 32 /dev/sd{g,h,i,j} -C 创建 -v 详细信息 -l 阵列级别 -n 阵列成员数量 -x 阵列备用盘数量 -c 或--chunk= 设定阵列的块 chunk 块大小

[root@Centos83 ~]# mdadm -D /dev/md5 # 查看创建的raid5

/dev/md5:

Version : 1.2

Creation Time : Wed Jul 14 12:58:12 2021

Raid Level : raid5

Array Size : 41908224 (39.97 GiB 42.91 GB)

Used Dev Size : 20954112 (19.98 GiB 21.46 GB)

Raid Devices : 3

Total Devices : 4

Persistence : Superblock is persistentState : clean

Active Devices : 3Layout : left-symmetric

Chunk Size : 32KName : Centos83:5 (local to host Centos83)

UUID : 6aa36e8d:117754ec:828b2cff:3a633a61

Events : 18(2) 扩展 RAID5 磁盘阵列 [root@Centos83 ~]# mdadm -G /dev/md5 -n 4 -c 32 #-G 或--grow 改变阵列大小或形态

[root@Centos83 ~]# mdadm -Dsv > /dev/mdadm.conf #保存配置文件

[root@Centos83 ~]# mdadm -D /dev/md5 #查看状态

/dev/md5:

Version : 1.2

Creation Time : Wed Jul 14 12:58:12 2021

Raid Level : raid5

Array Size : 41908224 (39.97 GiB 42.91 GB) #空间暂时未变大

Used Dev Size : 20954112 (19.98 GiB 21.46 GB)

Raid Devices : 4

Total Devices : 4

Persistence : Superblock is persistentState : clean, reshaping

Active Devices : 4Layout : left-symmetric

Chunk Size : 32KName : Centos83:5 (local to host Centos83)

UUID : 6aa36e8d:117754ec:828b2cff:3a633a61

Events : 49Name : Centos83:5 (local to host Centos83)

UUID : 6aa36e8d:117754ec:828b2cff:3a633a61

Events : 61Version : 1.2

Creation Time : Wed Jul 14 12:58:12 2021

Raid Level : raid5

Array Size : 62862336 (59.95 GiB 64.37 GB) #空间已经变大

Used Dev Size : 20954112 (19.98 GiB 21.46 GB)

Raid Devices : 4

Total Devices : 4

Persistence : Superblock is persistentState : clean

Active Devices : 4Layout : left-symmetric

Chunk Size : 32KName : Centos83:5 (local to host Centos83)

UUID : 6aa36e8d:117754ec:828b2cff:3a633a61

Events : 61(4) 激活 MD5 阵列 [root@Centos83 ~]# mdadm -S /dev/md5 #-S 停止阵列

mdadm: stopped /dev/md5

[root@Centos83 ~]# mdadm -As #-A 激活磁盘阵列 s 扫描配置文件得到阵列信息

mdadm: /dev/md/5 has been started with 4 drives.14.2.5 创建 RAID10 实验环境: [root@Centos83 ~]# mdadm -C -v /dev/md10 -l 10 -n 4 /dev/sdk[1-4]-C 创建 -v 详细信息 -l 阵列级别 -n 阵列成员数量

mdadm: layout defaults to n2

mdadm: layout defaults to n2

mdadm: chunk size defaults to 512K

mdadm: size set to 2094080K

mdadm: Defaulting to version 1.2 metadata

mdadm: array /dev/md10 started.

[root@Centos83 ~]# cat /proc/mdstat

Personalities : [raid0] [raid1] [raid6] [raid5] [raid4] [raid10]

md10 : active raid10 sdk4[3] sdk3[2] sdk2[1] sdk1[0]

4188160 blocks super 1.2 512K chunks 2 near-copies [4/4] [UUUU]14.2.6 删除 RAID 所有信息及注意事项 [root@Centos83 ~]# umount /dev/md0 /raid0 #如果你已经挂载 raid,就先卸载

[root@Centos83 ~]# mdadm -Ss #停止 raid 设备

[root@Centos83 ~]# rm -rf /etc/mdadm.conf #删除 raid 配置文件

[root@Centos83 ~]# mdadm --zero-superblock /dev/sdb #清除物理磁盘中的 raid 标识 ,MD 超级块

[root@Centos83 ~]# mdadm --zero-superblock /dev/sd[b-j]

[root@Centos83 ~]# mdadm --zero-superblock /dev/sdk[1-4]

[root@Centos83 ~]# mdadm -Dsv #清除物理磁盘中的 raid 标识 ,MD 超级块总结: 14.1 RAID 概念-企业级 RAID-0-1-5-10 的工作原理 14.2 RAID-0-1-5-10 搭建及使用-删除 RAID 及注意事项 14.3 实战-企业中硬件 raid5 的配置

![]() 服务系统

发布于:2021-07-20 16:22

|

阅读数:474

|

评论:0

服务系统

发布于:2021-07-20 16:22

|

阅读数:474

|

评论:0

QQ好友和群

QQ好友和群 QQ空间

QQ空间