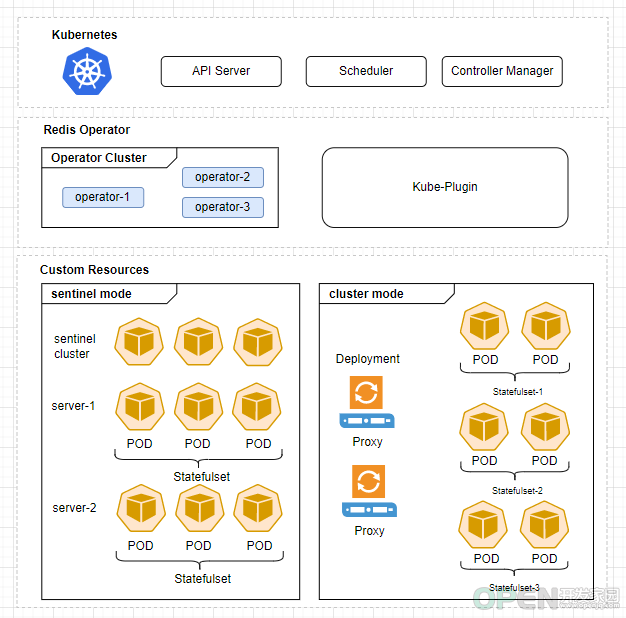

摘要 声明式管理,Operator工作原理,容器编排,主从模式,集群模式,高可用策略,集群扩缩容 可以助力业务平滑迁移、快速开发、稳定运维,大幅降低技术成本,节约硬件资源。 面临的挑战 Kubernetes 如何部署 Redis 有状态服务; 容器 Crash 后如何不影响服务可用性; 容器重启后如何保证 Redis 内存中的数据不丢; 节点水平扩容时如何做到 Slots 迁移时不影响业务; Pod ip变化后集群的状态如何处理。 声明式管理 “声明式”

Operator集群本身采用Deployment部署,由ETCD 完成选主,上层与Kubernetes的Api Server 、Controller Manager等组件进行通信,下层持续调和Redis集群状态。创建三个副本的Redis主从集群: apiVersion: Redis.io/v1beta1

kind: RedisCluster

metadata:

name: my-release

spec:

size: 3

imagePullPolicy: IfNotPresent

resources:

limits:

cpu: 1000m

memory: 1Gi

requests:

cpu: 1000m

memory: 1Gi

config:

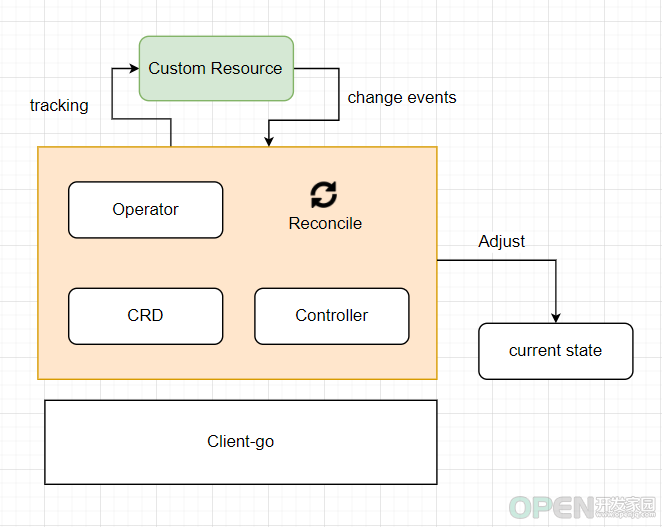

maxclients: "10000"Operator工作原理

CRD: CR: 容器编排 资源限制: request(资源需求):即运行Pod的节点必须满足运行Pod的最基本需求才能启动。

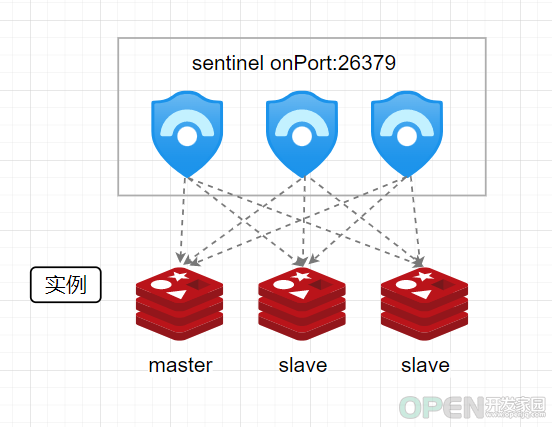

limit(资源限制):即运行Pod期间,可能内存使用量会增加,那最多能使用多少内存,这就是资源限额。一个有效的解决方式 部署的基本形态: 配置文件: 存储: 主从模式 主从拓扑图 原哨兵模式:

共用哨兵模式:

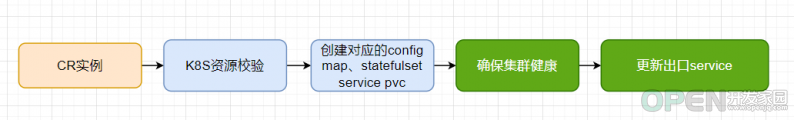

2. 调和原理

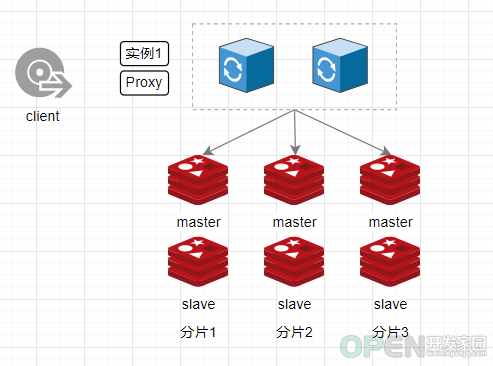

集群模式 集群拓扑图 Redis Cluster + Proxy模式: 对于操作单个Key的命令,Proxy会根据Key所属的Slot(槽)将请求发送给所属的数据分片。

对于操作多个Key的命令,如果这些Key是储存在不同的数据分片,Proxy会将命令拆分成多个命令分别发送给对应的分片。

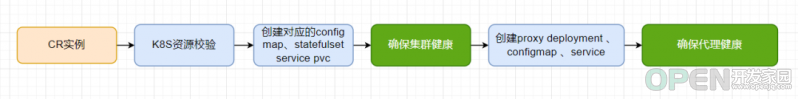

2. 调和原理

确保集群健康的步骤: 处理不可信节点 (所有handshake状态的节点),发生于某一个节点被移除(由forget node触发),但试图加入集群时,即该Pod在Operator角度下存在,但实际集群节点并不需要该节点,处理方式为删掉这个Pod,并再次做forget操作直到Pod被删除。 为StatefulSet中的Pod建立主从关系,同时给其分配Slots。若当前Master数量同预期不一致,则对应扩缩容操作,具体见’集群扩缩容’的横向扩缩容小节。 确保代理健康的步骤: 若代理中无可用Redis Server, 表示被全部移除,则添加一个,代理可自动发现集群其他Redis节点。 高可用策略 1. Kubernetes保证的高可用 (1) 容器部署保证高可用: Pod未出问题,但程序不可用时,依托于健康检查策略,Kubernetes也将重启该Redis节点。 (2) 滚动升级: (3) 调度的高可用: spec:

affinity:

podAntiAffinity:

preferredDuringSchedulingIgnoredDuringExecution:

- podAffinityTerm:

labelSelector:

matchLabels:

Redis.io/name: instance1

topologyKey: Kubernetes.io/hostname

weight: 12. Redis集群的高可用 ,下面以哨兵模式模式为例描述集群如何进行故障恢复。 主节点宕机 :因物理节点驱逐、节点重启、进程异常结束等导致的Redis主节点宕机情况,哨兵会进行切主操作,然后K ub ernetes会在可用物理节点上重新拉起一个Pod。 从节点宕机 :哨兵模式的Redis集群未开启读写分离,从节点宕机对服务无影响,后续Kubernetes会重启拉起一个Pod,Operator会将该Pod设置为新主节点的从节点。 集群全部节点宕机 :节点网络故障 :当节点被一个 Sentinel 节点记为主观下线时,并不意味着该节点肯定故障了,还需要Sentinel集群的其他Sentinel节点共同判断为主观下线才行。 该 Sentinel 节点会询问其他Sentinel节点,如果 Sentinel 集群中超过 quorum 数量的 Sentinel 节点认为该 Redis 节点主观下线,则该 Redis 客观下线。 如果客观下线的 Redis 节点是从节点或者是Sentinel节点,则操作到此为止,没有后续的操作了;如果客观下线的Redis节点为主节点,则开始故障转移,从从节点中选举一个节点升级为主节点。 集群模式故障转移与上述类似,不过不需要哨兵干预,而是由节点之间通过PING/PONG实现。 监控观测 集群扩缩容 (1)纵向扩缩容 纵向扩缩容主要指Pod的CPU、内存资源的调整,基于Kubernetes的特性,只需修改实例对应的spec字段 (2)横向扩缩容 总结与展望 Redis 容器化后有哪些优势? 部署 :部署更快,集群建立无需人工干预。容器部署后可保证每个的Redis节点服务正常,节点启动后将由Operator持续监测调和Redis集群状态,包括主从关系、集群关系、哨兵监控、故障转移等。资源隔离 :如果所有服务都用同一个集群,修改了Redis集群配置的话,很可能会影响到其他的服务。但如果你是每个系统独立用一个Redis群的话,彼此之间互不影响,也不会出现某一个应用不小心把集群给打挂了,然后造成连锁反应的情况。故障恢复: 扩缩容 :容器部署可根据limit和request限制实例的cpu和内存,也可以进行扩缩容操作,扩容后的故障恢复由Operator处理节点调整 :基于Operator对CRD资源的持续调和,可在Operator的Controller中为每个Redis实例进行状态维护,因此,节点调整后带来的主副关系建立、集群Slots迁移等均可自动完成。数据存储 :容器化可挂载Cephfs、LocalStorage等多种存储卷。监控与维护 :实例隔离后搭配Exporter、Prometheus等监控工具更容易发现问题。

![]() 游戏开发

发布于:2022-01-02 10:17

|

阅读数:321

|

评论:0

游戏开发

发布于:2022-01-02 10:17

|

阅读数:321

|

评论:0

QQ好友和群

QQ好友和群 QQ空间

QQ空间